A LLYC lança The Purple Check, uma inteligência artificial que ajuda a falar e a denunciar melhor a violência de gênero. A ferramenta funciona de forma simples. Basta introduzir um título e a solução verifica se as palavras utilizadas estão em conformidade com as regras de boas práticas derivadas dos guias do Programa das Nações Unidas para o Desenvolvimento (PNUD) e da Rede Mediterrânica de Autoridades Reguladoras (MNRA). Caso contrário, recomendará como dizer a mesma coisa para informar sem promover a desigualdade e assim devolver o foco à comunicação.

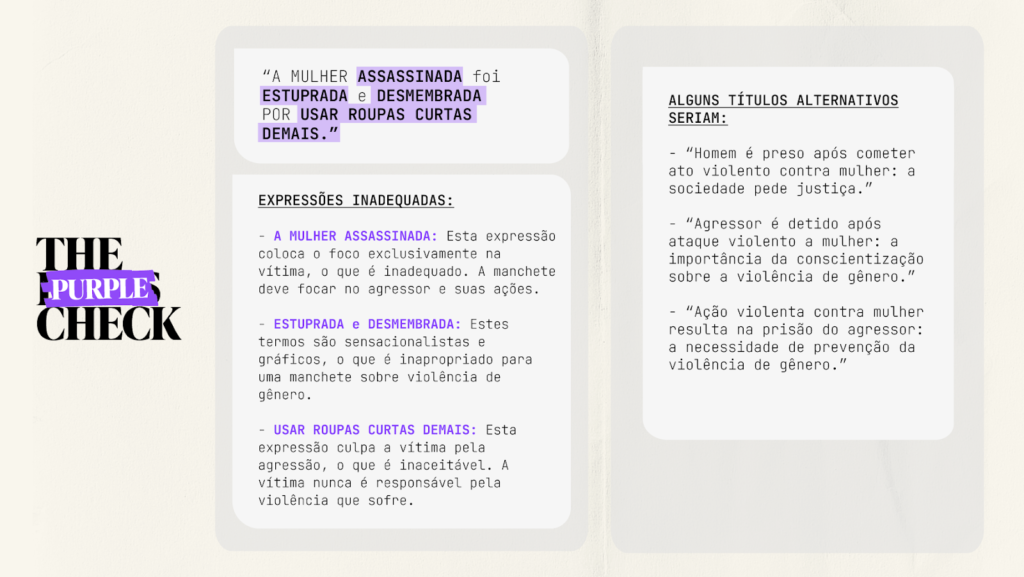

Aqui está um exemplo da alternativa do The Purple Check a uma manchete que apareceu em um meio de comunicação:

Luisa García, Sócia e COO Global da LLYC, destaca que o Purple Check reflete o compromisso da LLYC com a igualdade. “É uma contribuição que damos através da inovação e da nossa própria ferramenta de IA para gerar consciência social. Precisamos de um tratamento mais objetivo, equilibrado e justo da informação. A solução permite-nos focar as notícias numa perspectiva de gênero. Somente se todos detectarmos preconceitos poderemos fazer da linguagem outra ferramenta de mudança.”

O Purple Check surge das conclusões do relatório “Desfocadas: como opinar e informar melhor sobre a violência de gênero” realizado pela LLYC no âmbito do 8 de março, Dia Internacional da Mulher. O estudo conclui que embora os meios de comunicação social conscientizem, sensibilizem e previnam a violência de gênero duas vezes mais do que as redes sociais, ainda há muito trabalho pela frente. Ainda assim, 20% das notícias publicadas justificam ataques e uma em cada seis viola a privacidade das vítimas ao expor dados pessoais que prefeririam evitar.

Para elaborar este relatório, a equipe de Deep Learning da LLYC analisou 226,2 milhões de notícias gerais, 5,4 milhões de notícias sobre violência de gênero e 14 milhões de mensagens na rede social X(antigo Twitter) em 12 países onde a consultora está presente (Argentina, Brasil, Chile, Colômbia, Equador, Espanha, Estados Unidos, México, Panamá, Peru, Portugal e República Dominicana). Na pesquisa foram utilizados Large Language Models (LLMs- GPT4) para identificar e isolar descritores direcionados à vítima e ao agressor, em notícias públicas obtidas por meio de modelos scraper, bem como técnicas de Processamento de Linguagem Natural (PNL) em 4 idiomas.

“Aqueles de nós que participamos na conversa social sabemos que dar visibilidade à violência de gênero é essencial para avançar na sua erradicação. Contudo, fazer algo errado pode ser contraproducente, gerando sensacionalismo e causando dupla vitimização. Na LLYC queremos não só destacar este risco, mas também fornecer ferramentas para o evitar”, afirma Luisa García.